一种知识与数据协同驱动的无人机航拍目标检测方法与流程

1.本发明属于目标检测领域,具体涉及到一种知识与数据协同驱动的无人机航拍目标检测方法。

背景技术:

2.目标检测是计算机视觉领域的基本任务之一,它的任务是找出图像中所有的目标,并确定目标的类别、位置,在智能化交通系统、人脸识别、医学图像检测等领域具有广泛的应用价值。近些年随着深度学习技术的火热发展,目标检测算法也从基于手工设计特征的传统算法转向了基于深度神经网络的检测技术。目前基于深度学习的目标检测算法可分为基于候选框的两阶段目标检测算法和基于回归的单阶段目标检测算法。前者平均检测精度更高,后者检测速度更快。

3.尽管这两类主流算法通过不断的改进,在检测精度与速度上面得到很大提升,然而在无人机航拍场景下依然面临诸多挑战。无人机航拍图像相较于通用数据集图像,其背景更加复杂,物体尺度变化更大,目标分布更加密集。同时这些主流算法的共同点是单独处理每个对象区域而不考虑目标之间的关键语义关系和空间分布关系,因此在无人机航拍场景下进行目标检测往往不确定性高,误检率大。

4.因此本发明充分考虑了上述实际场景中存在部分目标特征质量较差问题以及当前主流目标检测算法均未利用目标间的关联关系问题,提出一种知识与数据协同驱动的无人机航拍目标检测方法。

技术实现要素:

5.发明目的:本发明所要解决的技术问题是针对现有技术的不足,提出一种知识与数据协同驱动的无人机航拍目标检测方法。该方法引入人类先验常识,将图卷积网络提取到的语义特征和空间特征自适应融合,得到强化特征,从而降低检测目标的不确定性,提高其检测精度。

6.为了解决上述技术问题,本发明公开了一种知识与数据协同驱动的无人机航拍目标检测方法,包括以下步骤。

7.步骤1,准备无人机航拍场景下的训练数据集。

8.步骤2,基于训练数据集,利用先验常识构建知识图谱。

9.步骤3,构建无人机航拍目标检测网络模型。

10.步骤4,基于训练数据集和知识图谱,训练所述无人机航拍目标检测网络模型,获得训练后的无人机航拍目标检测网络模型。

11.步骤5,利用训练后的无人机航拍目标检测网络模型对输入的测试图片进行测试,获得目标定位和分类结果。

12.进一步的,步骤3中所述无人机航拍目标检测网络模型包括深度特征提取模块、语义关系模块、空间关系模块、注意力融合模块和分类模块。

13.所述深度特征提取模块,用于提取输入的无人机航拍图片的候选框位置和候选区原始特征。

14.所述语义关系模块,用于基于所述知识图谱和无人机航拍图片候选区原始特征,获得无人机航拍图片的语义特征。

15.所述空间关系模块,用于基于无人机航拍图片的候选框位置和候选区原始特征,获得无人机航拍图片的空间特征。

16.所述注意力融合模块,用于基于无人机航拍图片的语义特征和空间特征,获得无人机航拍图片的强化特征。

17.所述分类模块,用于基于无人机航拍图片的强化特征,获得无人机航拍图片对应的目标检测结果。

18.进一步的,步骤2包括:从所述训练数据集抽取出所有的目标类,基于人类先验常识,比如“人在自行车上”,构建《物体1,关系,物体2》的三元组,使用图数据库neo4j进行存储并构建所述训练数据集对应的知识图谱,所述知识图谱的邻接矩阵记为x,,n为知识图谱中节点的个数,d为每个节点的特征向量的维度。

19.进一步的,步骤3中所述无人机航拍目标检测网络模型中的深度特征提取模块和分类模块分别使用faster rcnn网络的深度特征提取网络和分类器。

20.进一步的,步骤3中所述无人机航拍目标检测网络模型中的语义关系模块包括图卷积网络,步骤4在训练所述无人机航拍目标检测网络模型时,语义关系模块执行以下步骤。

21.将知识图谱的邻接矩阵记x输入图卷积网络处理,提取包含目标间语义信息的特征;将提取到的语义信息与原始特征矩阵进行矩阵点乘融合,并经过全连接层将其变换成与原始特征相同的维度,然后利用注意力机制,使其与原始特征带权融合,获得无人机航拍图片的语义特征x

semantic

,表达式如下。

22.其中,x

cnn

代表深度特征提取模块提取的候选区原始特征,fc代表全连接层,代表两矩阵点乘,||代表级联,α

se

代表语义关系模块学习到的注意力参数,代表通过图卷积网络得到的包含目标间语义信息的特征,表达式如下。

23.其中是在图卷积网络的第l层输出的特征图,l∈l

gcn

,l

gcn ≥ 3,l

gcn

为图卷积网络总层数,l是拉普拉斯矩阵,σ(

·

)是非线性激活函数;图卷积网络的第一层的输入由知识图谱结构定义,表示语义关系模块学习获得的语义关系权重矩阵。

24.将图结构的知识图谱输入图卷积网络能够在原始节点的基础上聚合图中各节点特征,起到更新节点的作用。考虑训练过程中提取到的语义信息在特征融合过程中所占比重是动态变化的,本发明融入了注意力机制,通过将图卷积网络所得到的语义信息与原始特征带权融合得到语义特征,提高了所获得的语义特征的质量,进一步增强了网络的鲁棒

性。

25.进一步的,步骤3中所述无人机航拍目标检测网络模型中的空间关系模块包括图注意力网络,步骤4在训练所述无人机航拍目标检测网络模型时,空间关系模块执行以下步骤。

26.将无人机航拍图片的候选框位置输入图注意力网络,计算当前候选框和图片中其他候选框之间的相对位置,获得候选框的空间信息。

27.利用多头注意力机制聚合候选框的空间信息,将聚合后的候选框的空间信息与候选区原始特征进行带权融合,获得无人机航拍图片的空间特征x

spatial

,表达式如下。

28.其中,α

sp

代表空间关系模块学习到的注意力参数,k是图注意力网络中多头注意力机制的数量且k ≥ 1,

⨁

表示两矩阵内元素两两相加,表示图注意力网络第m+1层输出的候选框空间信息,表达式如下。

29.其中σ

ij

为图注意力网络经过softmax得到的空间关系注意力系数;代表空间关系模块学习得到的空间关系权重矩阵;r

ij

代表第i个候选框和第j个候选框之间的相对位置,1 ≤ i,j≤ n;n为候选框个数;是在图注意力网络第m层输出的特征图,m∈l

gat

,l

gat ≥ 3,l

gat

为图注意力网络总层数。

30.由于不同的图片待检测目标的位置是变化的,我们无法预先构建固定的空间关系图,因此本实施例通过引入自注意力机制,使用图注意力网络让网络关注候选框位置,并设计网络通过计算两个候选框的相对位置来间接表示目标之间的空间位置关系,从而实现提取空间信息的功能。

31.进一步的,步骤3中所述无人机航拍目标检测网络模型中的注意力融合模块利用注意力机制,自适应融合语义特征和空间特征,获得无人机航拍图片的强化特征x

enhance

,表达式如下。

32.x

enhance

= α

⊙

x

smantic

+(1-α)

⊙

x

spatial

其中,α表示注意力融合模块的注意力系数,表达式如下。

33.α =σ (w x

smantic + b)其中,w和b为注意力融合模块的学习参数。

34.通过将图像所包含的语义信息和空间信息融入到原始特征中,使得特征内容和质量大大增强,从而提升了目标检测性能。但在无人机航拍场景中,一张图片往往存在着不同尺寸的目标,且往往大小差异较大,这使得检测到的目标,其空间和语义信息可能存在一定的冲突,从而干扰模型的判断,最终导致检测失败。注意力融合模块能够使语义特征和空间特征在训练过程中自适应的融合,从而保证所述语义关系模块和空间关系模块的有效性。

35.进一步的,步骤4中训练所述无人机航拍目标检测网络模型的损失函数使用

faster rcnn网络的损失函数。

36.进一步的,步骤1中的训练数据集使用visdrone2019数据集。与常规数据集中一张图片包含一个或者几个待检测物体不同,该数据集每张图片包含上百个待检测物体,并且因为数据集是由无人机拍摄而来,目标以及对应的标注框非常小,并且存在遮挡、模糊等情况,常规目标检测模型很难得到高精度的检测结果。

37.进一步的,步骤5包括。

38.将测试图片输入深度特征提取模块,获得候选框位置和候选区原始特征。

39.将候选区原始特征输入语义关系模块,获得测试图片的语义特征。

40.将候选框位置和候选区原始特征输入空间关系模块,获得测试图片的空间特征。

41.将语义特征和空间特征输入注意力融合模块,获得测试图片的强化特征。

42.将强化特征输入分类模块,获得测试图片的目标检测结果,所述目标检测结果包括目标定位和分类结果。

43.有益效果:本发明与现有技术相比较,具有如下显而易见的突出性特点和显著优点。

44.1. 本发明方法将人类先验常识以知识图谱的形式融入到候选区原始特征中,得到语义特征。这样可以将人工构建的语义关系知识与深度学习提取得到的特征相融合,降低目标检测的不确定性,增强检测模型的准确性。

45.2. 本发明方法将注意图卷积提取到的目标间的空间位置关系融入到候选区原始特征中,得到空间特征,从而降低目标检测的不确定性,增强检测模型的准确性。

46.3. 本发明方法引入注意力机制,使语义特征和空间特征自适应融合,得到增强特征,增强检测模型的准确性。

附图说明

47.下面结合附图和具体实施方式对本发明做更进一步的具体说明,本发明的上述和/或其他方面的优点将会变得更加清楚。

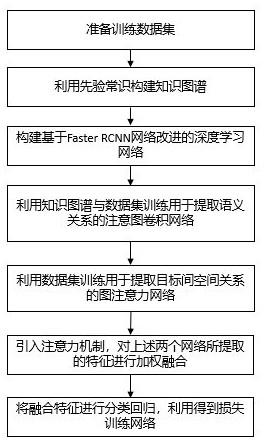

48.图1是本技术实施例提供的无人机航拍目标检测方法中模型训练的工作流程图。

49.图2是本技术实施例提供的无人机航拍目标检测方法进行目标检测的工作流程图。

50.图3是本技术实施例提供的无人机航拍目标检测模型的训练流程图。

51.图4是本技术实施例提供的无人机航拍目标检测模型的测试流程图。

52.图5是faster rcnn网络提供的目标检测结果示意图一。

53.图6是faster rcnn网络提供的目标检测结果示意图二。

54.图7是本技术实施例提供的无人机航拍目标检测方法的结果示意图一。

55.图8是本技术实施例提供的无人机航拍目标检测方法的结果示意图二。

具体实施方式

56.下面将结合附图,对本发明的实施例进行描述。

57.本发明提供的一种知识与数据协同驱动的无人机航拍目标检测方法在faster rcnn网络的基础上加以改进,在原有的特征提取模块和分类模块的基础上添加了语义关系

模块、空间关系模块和注意力融合模块,从而更容易检测出无人机航拍复杂场景下的弱小目标,降低目标检测的不确定性,提高无人机航拍目标检测的准确率,包括以下步骤。

58.步骤1,准备无人机航拍场景下的训练数据集。

59.步骤2,基于训练数据集,利用先验常识构建知识图谱。

60.步骤3,构建无人机航拍目标检测网络模型。

61.步骤4,基于训练数据集和知识图谱,训练所述无人机航拍目标检测网络模型,获得训练后的无人机航拍目标检测网络模型。

62.步骤5,利用训练后的无人机航拍目标检测网络模型对输入的测试图片进行测试,获得目标定位和分类结果。

63.其中,如图3和图4所示,步骤3中所述无人机航拍目标检测网络模型包括深度特征提取模块(骨干网络)、语义关系模块、空间关系模块、注意力融合模块和分类模块,深度特征提取模块的输入为待检测图片,输出为候选区原始特征;语义关系模块输入为人类先验常识和原始特征,输出为语义特征;空间关系模块输入为候选框位置和原始特征,输出为空间特征;注意力融合模块使用注意力机制,输入为语义特征和空间特征,输出为强化特征;分类模块进行分类回归,输入为强化特征,输出为图片对应的检测结果。

64.如图1所示为本技术实施例提供的无人机航拍目标检测方法中模型训练的工作流程图。步骤1中,本实施例选取的训练数据集为visdrone2019数据集,该数据集由无人机捕获,包括288个视频片段,总共包括261908帧和10209个静态图像。这些帧由260多万个常用目标(如行人、汽车、自行车和三轮车)的手动标注框组成。与常规数据集中一张图片包含一个或者几个待检测物体不同,该数据集每张图片包含上百个待检测物体,并且因为数据集是由无人机拍摄而来,目标以及对应的标注框非常小,并且存在遮挡、模糊等情况,常规目标检测模型很难得到高精度的检测结果。这也对网络如何提取和利用图片中的信息来提高检测精度的能力形成了一定挑战。

65.步骤2中,本实施例从选择的数据集中抽取出所有的目标类,基于人类先验常识,比如“人在自行车上”,构建《物体1,关系,物体2》这样的三元组,并使用图数据库neo4j来进行存储并构建出该数据集对应的知识图谱,所述知识图谱的邻接矩阵记为x,,n为知识图谱中节点的个数,d为每个节点的特征向量的维度。

66.步骤3中,深度特征提取网络的输入为待检测图片,输出为候选区原始特征,起到为本实施例的空间特征提取网络和语义特征提取网络进行数据预处理的作用。

67.步骤3中所述无人机航拍目标检测网络模型中的语义关系模块包括图卷积网络,该分支网络输入为事先构建的基于人类先验常识的知识图谱和深度特征提取网络所提取到的原始特征,输出为包含语义特征的候选区特征。将图结构的知识图谱输入图卷积网络能够在原始节点的基础上聚合图中各节点特征,起到更新节点的作用,用公式可以表示为。

68.其中是在图卷积网络的第l层输出的特征图,l∈l

gcn

,l

gcn ≥ 3,l

gcn

为图卷积网络总层数,l是拉普拉斯矩阵,σ(

·

)是非线性激活函数;图卷积网络的第一层的输入往往

由知识图谱结构定义,表示语义关系模块学习获得的语义关系权重矩阵。

69.考虑训练过程中提取到的语义信息在特征融合过程中所占比重是动态变化的,本发明融入了注意力机制,通过将图卷积网络所得到的语义信息与原始特征带权融合得到语义特征,提高了所获得的的语义特征的质量,进一步增强了网络的鲁棒性。

70.步骤4在训练所述无人机航拍目标检测网络模型时,语义关系模块主要用于将语义信息和原始特征融合得到语义特征x

semantic

,融合计算式如下。

71.其中,x

cnn

代表深度特征提取模块提取的候选区原始特征,fc代表全连接层,代表两矩阵点乘,||代表级联,α

se

代表语义关系模块学习到的注意力参数,代表通过图卷积网络得到的包含目标间语义信息的特征。

72.步骤3中所述无人机航拍目标检测网络模型中的空间关系模块包括图注意力网络,具体的,该分支网络输入为候选框位置和候选区的原始特征图,输出为包含空间特征的候选区特征。由于不同的图片待检测目标的位置是变化的,我们无法预先构建固定的空间关系图,因此本实施例通过引入自注意力机制,使用图注意力网络让网络关注候选框位置,并设计网络通过计算两个候选框的相对位置来间接表示目标之间的空间位置关系,从而实现提取空间信息的功能。

73.步骤4在训练所述无人机航拍目标检测网络模型时,空间关系模块主要用于将空间信息和原始特征融合得到空间特征x

spatial

,融合计算式如下。

74.其中,α

sp

代表空间关系模块学习到的注意力参数,k是执行注意图卷积时多头注意力机制的数量且k ≥ 1,本实施例中,参考transformer中多头注意力机制的基本设置,k取值为8;

⨁

表示两矩阵内元素两两相加,表示图注意力网络第m+1层输出的候选框空间信息,表达式如下。

75.其中σ

ij

为图注意力网络经过softmax得到的空间关系注意力系数;代表空间关系模块学习得到的空间关系权重矩阵;r

ij

代表第i个候选框和第j个候选框之间的相对位置,1 ≤ i,j≤ n;n为候选框个数;是在图注意力网络第m层输出的特征图,m∈l

gat

,l

gat ≥ 3,l

gat

为图注意力网络总层数。

76.步骤3中所述无人机航拍目标检测网络模型中的注意力融合模块引入注意力机制,对上述两个网络所提取的特征进行加权融合。

77.上述注意力机制,其注意力参数计算式如下。

78.α =σ (w x

smantic + b)其中,α表示注意力融合模块的注意力系数,w和b为注意力融合模块的学习参数。

79.利用注意力机制,自适应融合空间特征和语义特征所得到强化特征x

enhance

计算式如下。

80.x

enhance

= α

⊙

x

smantic

+(1-α)

⊙

x

spatial

将融合特征进行分类回归,损失函数使用faster rcnn网络的损失函数,利用得到损失训练所述无人机航拍目标检测网络。

81.如图2所示,步骤5包括:将测试图片输入深度特征提取模块,获得候选框位置和候选区原始特征。

82.将候选区原始特征输入语义关系模块,获得测试图片的语义特征。

83.将候选框位置和候选区原始特征输入空间关系模块,获得测试图片的空间特征。

84.将语义特征和空间特征输入注意力融合模块,获得测试图片的强化特征。

85.将强化特征输入分类模块,获得测试图片的目标检测结果,所述目标检测结果包括目标定位和分类结果。

86.图5、图6、图7和图8是现有技术faster rcnn网络提供的目标检测结果和本实施例提供的无人机航拍目标检测方法的结果,由两个对比图样例可以看出,本实施例提供的无人机航拍目标检测方法不仅检测精度提升了,同时在语义特征和空间特征的辅助下,可以看出远处的小目标也能够检测到,同时在图6和图8中可以看出,由于知识图谱中人与自行车有关联,所以在本实施例提出的方法可以检测出模糊小目标人身下的自行车,增强了检测模型的准确性。

87.具体实现中,本技术提供计算机存储介质以及对应的数据处理单元,其中,该计算机存储介质能够存储计算机程序,所述计算机程序通过数据处理单元执行时可运行本发明提供的一种知识与数据协同驱动的无人机航拍目标检测方法的发明内容以及各实施例中的部分或全部步骤。所述的存储介质可为磁碟、光盘、只读存储记忆体(read-only memory,rom)或随机存储记忆体(random access memory,ram)等。

88.本领域的技术人员可以清楚地了解到本发明实施例中的技术方案可借助计算机程序以及其对应的通用硬件平台的方式来实现。基于这样的理解,本发明实施例中的技术方案本质上或者说对现有技术做出贡献的部分可以以计算机程序即软件产品的形式体现出来,该计算机程序软件产品可以存储在存储介质中,包括若干指令用以使得一台包含数据处理单元的设备(可以是个人计算机,服务器,单片机,muu或者网络设备等)执行本发明各个实施例或者实施例的某些部分所述的方法。

89.本发明提供了一种知识与数据协同驱动的无人机航拍目标检测方法,具体实现该技术方案的方法和途径很多,以上所述仅是本发明的具体实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理的前提下,还可以做出若干改进和润饰,这些改进和润饰也应视为本发明的保护范围。本实施例中未明确的各组成部分均可用现有技术加以实现。

- 目标图像的更新方法及系统、晶...

- 关键词识别方法、装置、设备及...

- 基于自主移动机器人的调度方法...

- 一种防错位型嵌入式单片机

- 一种适用碳信用评价的联邦学习...

- 图像分类模型训练方法、图像分...

- 一种基于结构特征的遥感图像配...

- 一种计算机主机用放置箱的制作...

- 一种带有束线功能的笔记本外壳...

- 一种适用于有限元分析的梁单元...

- 还没有人留言评论。精彩留言会获得点赞!